Du har måske eller måske ikke hørt om prompt engineering. I bund og grund handler det om "at kommunikere effektivt med en AI for at få det, du ønsker".

De fleste mennesker ved ikke, hvordan man laver gode opgaver.

Dog bliver det en stadigt vigtigere færdighed...

For hvad man putter i = hvad man får ud.

Her er de vigtigste teknikker du har brug for at overtale

Jeg vil henvise til en sprogmodel som 'LM'.

Eksempler på sprogmodeller er @OpenAI's ChatGPT og @AnthropicAI's Claude.

1. Persona/rollepromptning

Tildel en rolle til AI'en.

Eksempel: "Du er ekspert i X. Du har hjulpet mennesker med at gøre Y i 20 år. Din opgave er at give den bedste rådgivning om X.

Svar 'forstået' hvis det er forstået."

En kraftig tilføjelsesfunktion er følgende:

‘Du skal altid stille spørgsmål, før du svarer, så du bedre kan forstå, hvad spørgeren søger.’

Jeg vil tale om, hvorfor det er så vigtigt om et øjeblik.

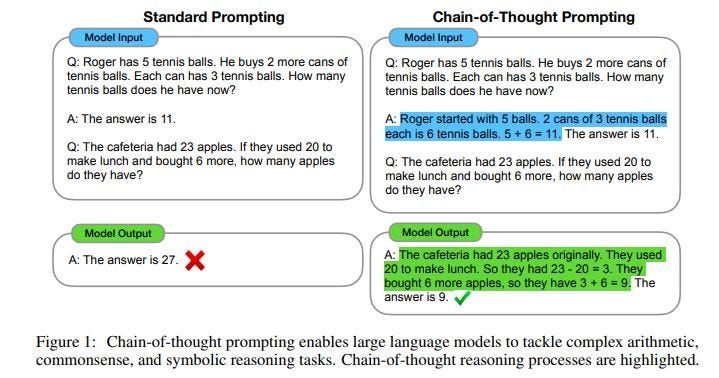

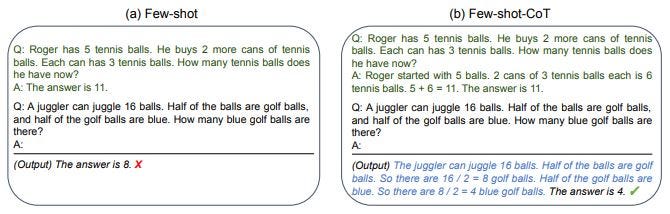

2. CoT

CoT står for 'Chain of Thought'

Det bruges til at instruere LM'en til at forklare sin ræsonnering.

Eksempel:

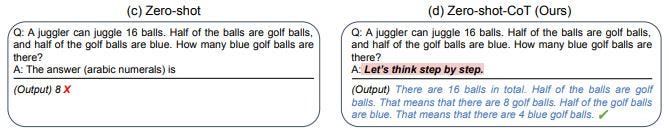

3. Nulspor-CoT

Zero-shot refererer til en model, der laver forudsigelser uden yderligere træning inden for prompten.

Jeg kommer til få-skud om et øjeblik.

Bemærk, at normalt CoT > Zero-shot-CoT

Eksempel:

4. Few-shot (og few-shot-CoT)

Few-shot er når LM'en får nogle få eksempler i prompten for at den hurtigere kan tilpasse sig nye eksempler.

Eksempel:

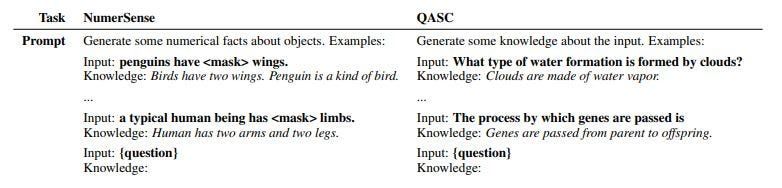

5. Vidensgenerering

Generering af spørgsmålrelateret viden ved at fremprovokere et sprogmodel.

Dette kan bruges til en genereret viden prompt (se videre).

Eksempel:

6. Genereret viden

Nu hvor vi har kendskab, kan vi fodre den info ind i en ny prompt og stille spørgsmål relateret til kendskabet.

En sådan spørgsmål kaldes et 'vidensforøget' spørgsmål.

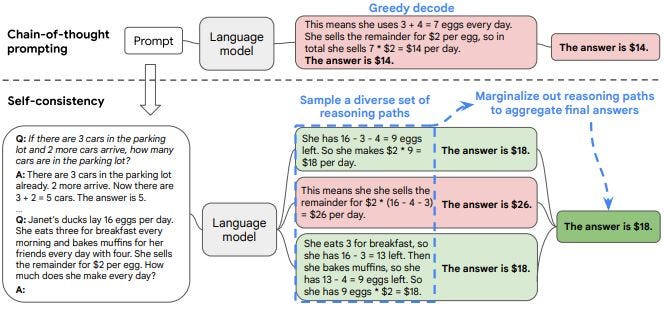

7. Selv-konsistens

Denne teknik bruges til at generere multiple tænkeveje (tankemønstre).

Den mest almindelige svar tages som det endelige svar.

Eksempel:

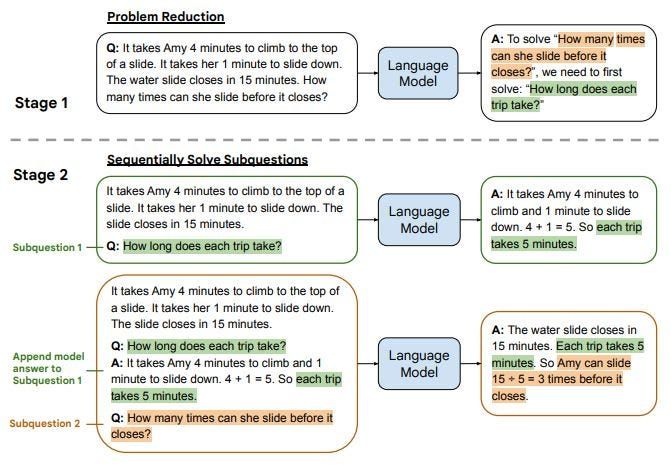

8. LtM

LtM står for 'Least to Most'

Denne teknik er en opfølgning på CoT (Centre of Translation). Derudover fungerer den ved at opdele et problem i underproblemer og derefter løse dem.

Eksempel: