ChatGPT's avancerede evner såsom debugging af kode, at skrive en essay eller en vittighed, har ført til dens enorme popularitet. På trods af dens evner har dens assistance hidtil været begrænset til tekst - men det vil ændre sig.

Tirsdag præsenterede OpenAI GPT-4, en stor multimodal model der accepterer både tekst- og billedeindgange og genererer tekst som output.

Også: Sådan får du ChatGPT til at angive kilder og citater

Skelnen mellem GPT-3.5 og GPT-4 vil være "subtil" i en uformel samtale. Dog vil den nye model være langt mere kapabel hvad angår pålidelighed, kreativitet og endda intelligens.

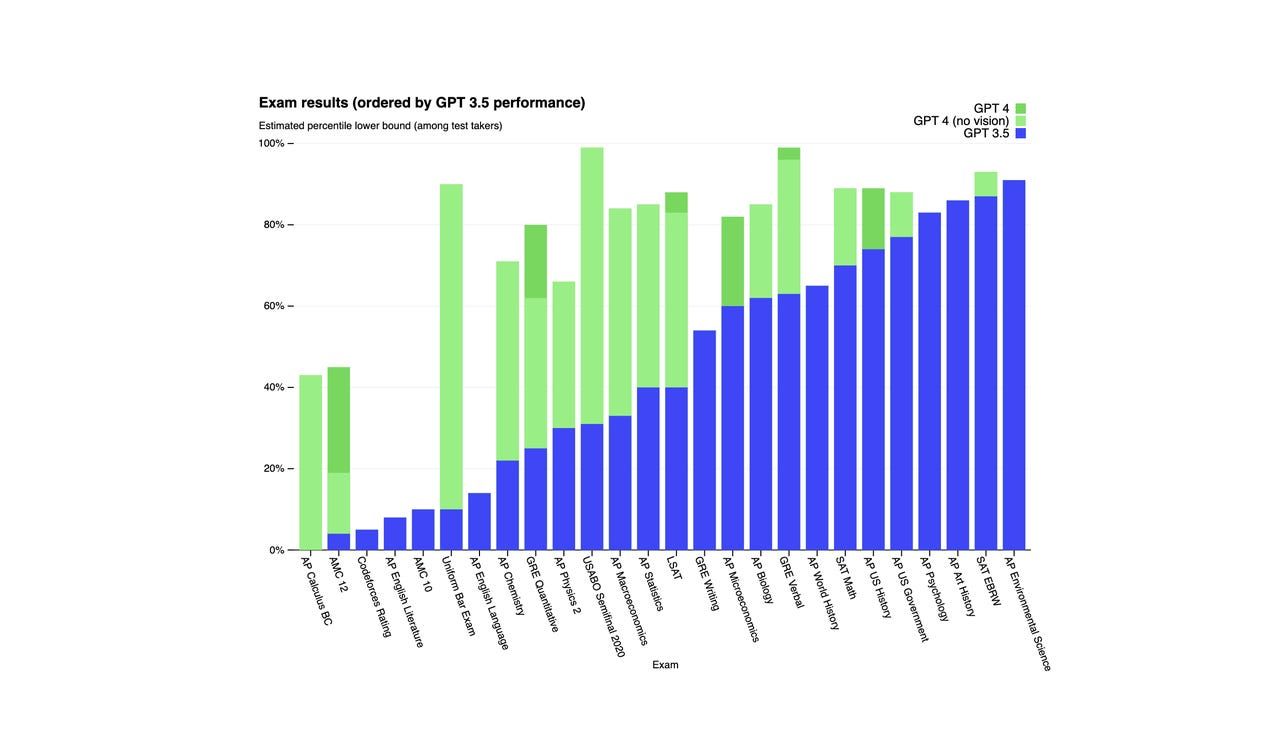

Ifølge OpenAI scorede GPT-4 i top 10% af en simuleret eksamen i en bar, mens GPT-3.5 scorede omkring bunden 10%. GPT-4 overgik også GPT-3.5 i en række benchmark-test som det ses af grafen nedenfor.

Til kontekst kører ChatGPT på en sprogmodel, der er fintunet fra en model i serien 3.5, hvilket begrænser chatbotten til tekstudgang.

OpenAI's GPT-4 meddelelse fulgte efter en tale fra Andreas Braun, CTO for Microsoft Tyskland, tidligere på ugen, hvor han sagde at GPT-4 snart ville blive tilgængelig og ville muliggøre tekst-til-video-generering.

Også: Hvordan fungerer ChatGPT?

"Vi vil introducere GPT-4 næste uge; der vil vi have multimodale modeller, der vil tilbyde helt forskellige muligheder - for eksempel videoer," sagde Braun ifølge Heise, et tysk nyhedsmedie, ved arrangementet.

Udover at være multimodal er påstandene om en tekst-til-video-generator i GPT-4 lidt forkerte. Modellen kan endnu ikke producere video, men den kan acceptere visuelle input, hvilket er et stort skridt i forhold til den tidligere model.

Et af eksemplerne, som OpenAI har givet for at fremvise denne funktion, viser ChatGPT, der scanner et billede i et forsøg på at finde ud af, hvad der var sjovt ved det på baggrund af brugerens input.

Andre eksempler inkluderede upload af et billede af en graf og bede GPT-4 om at lave beregninger ud fra det eller upload af et arbejdsark og bede det løse spørgsmålene.

Også: 5 måder ChatGPT kan hjælpe dig med at skrive et essay

OpenAI siger, at de vil udgive GPT-4's tekstindtastningsfunktion via ChatGPT og dens API via en venteliste. Du skal vente lidt længere på billedindtastningsfunktionen, da OpenAI samarbejder med en enkelt partner for at få den startet.

Hvis du er skuffet over ikke at have en tekst-til-video-generator, så fortvivl ikke, det er ikke en helt ny koncept. Tech-giganter som Meta og Google har allerede modeller i gang. Meta har Make-A-Video og Google har Imagen Video, der begge bruger AI til at producere video ud fra brugerens input.